来源:半岛电视台 + 电子网站

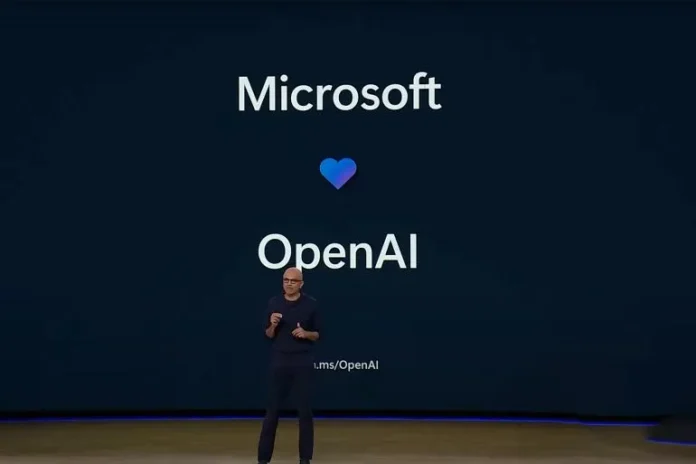

在微软“Build 2024”大会上,首席执行官萨提亚• 纳德拉发表了前瞻性的开幕演讲,强调了人工智能的巨大潜力。

纳德拉首先分享了微软长期以来的梦想,即开发能够简单理解人类需求的计算机,并使用人工智能来控制用户当前接触到的海量信息。他强调,当前的人工智能创新浪潮是实现这些宏伟目标的关键。

人工智能代理

“Build 2024”大会上最重要的公告之一是开发智能助手Copilot,使其成为人工智能代理。

这款智能助手旨在通过执行通常需要人工干预的任务来改变业务面貌。与之前的版本不同,新的人工智能代理将不再等待用户命令,而是可以主动管理任务,例如监控电子邮件和在用户设备上自动输入数据。

另一方面,微软商用应用及平台执行副总裁查尔斯·拉曼纳解释称,这些主动任务可以显著提高工作效率,想象一下Copilot处理公司IT服务台查询、新员工入职培训等任务的场景。

例如,智能助手Copilot可以欢迎新员工加入公司,帮助他登记人力资源数据、回答他的问题、把他介绍给他的队友、为他提供培训时间表、并为他安排第一周的会议,自动化这些任务将使人力资源人员能够专注于更具战略性和更复杂的任务。

然而,这种自动化的普及引起了员工对工作被取代的担忧,因此拉曼纳直接解决了这些担忧,并强调Copilot旨在执行工作中重复且单调的任务,因此其目标是为员工腾出时间来执行更复杂且需要人类思维元素的任务,他还表示,“我们相信有了Copilot,某些任务将会完全自动化,但好消息是大多数这些任务没有人愿意执行。”

小型多媒体模型

微软推出了一种名为“Phi-3 Vision”的新模型,这是其能够分析文本和图像的小语言模型的新版本。该模型拥有42亿个参数,设计为在移动设备上运行,从而在用户设备上提供先进的人工智能功能,而无需需要强大硬件的复杂计算机操作。

与DALL-E等大型模型不同,新版本的“Phi-3 Vision”不仅仅生成图像,而是擅长图形解释和图像分析等视觉推理任务。 该模型代表了向更高效的人工智能模型的重大转变,平衡了强大的功能与硬件资源效率。

实时翻译

微软在年度开发者大会上透露的另一个重要功能是Edge浏览器中的人工智能翻译和配音工具。

这一创新功能的目的是在Edge浏览器中提供YouTube、LinkedIn、Coursera等平台上的视频实时翻译,从而进一步增强内容的可访问性并打破语言障碍。最初,该功能将支持从西班牙语到英语以及从英语到其他几种语言的翻译,包括德语、印地语、意大利语、俄语和西班牙语,并计划在未来扩展以提供更多语言。

与合作伙伴合作

微软推出了一项新功能,可通过Meta的“Meta Quest”虚拟现实耳机将Windows应用程序扩展到3D空间。此功能允许开发人员创建可使用“Meta Quest”耳机进行操作的交互式3D可视化。

在教育领域,微软与可汗学院合作,为美国所有教师提供人工智能驱动的教育工具。这旨在提升学习体验,为更广泛的受众提供前沿的教育资源。

人工智能集成的未来

“Build 2024”上的公告标志着微软将人工智能技术整合到商业和消费者技术领域的战略重点。随着这些工具的发展和变得更加集成,它们有望提高生产力并创造新的创新机会。但它也引发了关于人工智能在不同工作场所的道德和实际影响的重要讨论。

将人工智能融入日常任务可能是一把双刃剑,一方面,它将提供效率、时间和执行工作任务的新方式。另一方面,需要采取谨慎的方法来确保这些技术增强人类的能力而不取代它们。拉曼纳认为,“人的判断与协作”至关重要,并非所有任务都适合自动化。

生成式人工智能模型也面临着持续的挑战,尤其是当这些模型在训练数据之外提供不正确或误导性信息时,会出现“幻觉”问题。微软证实,它已在Copilot工作室中实施了许多控制措施来减轻这些风险,以确保智能助手在特定标准下运行,并在必要时包括人工监督。